El análisis de regresión es una poderosa herramienta estadística que nos permite explorar la relación entre dos variables, ya sea considerando una como variable independiente (X) y la otra como variable dependiente (Y), o viceversa. En este análisis, se busca comprender cómo un cambio en una variable puede afectar a la otra, proporcionando valiosa información para la toma de decisiones y la predicción de resultados. ¡Descubre cómo desentrañar estas relaciones en el fascinante mundo del análisis de regresión!

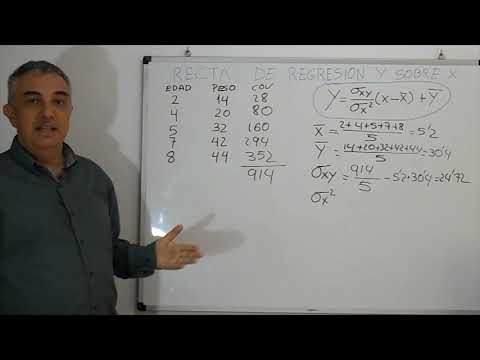

La recta de regresión de Y sobre X: Definición y aplicación

La recta de regresión de Y sobre X es un concepto utilizado en estadística que busca determinar la relación lineal entre dos variables, donde una de ellas (Y) se considera como variable dependiente y la otra (X) como variable independiente.

La principal finalidad de la recta de regresión de Y sobre X es encontrar la ecuación de una recta que se ajuste de la mejor manera posible a los datos observados, de modo que se pueda predecir el valor de la variable dependiente Y a partir de la variable independiente X.

Para calcular la recta de regresión de Y sobre X, se utiliza el método de los mínimos cuadrados, el cual consiste en minimizar la suma de los cuadrados de las diferencias entre los valores observados y los valores predichos por la recta de regresión.

La ecuación de la recta de regresión de Y sobre X se expresa de la siguiente manera:

Y = a + bX

Donde:

- a es la ordenada en el origen, es decir, el valor de Y cuando X es igual a 0.

- b es la pendiente de la recta, que indica el cambio en Y por cada unidad de cambio en X.

La recta de regresión de Y sobre X se utiliza comúnmente en la predicción de valores futuros o en la modelización de fenómenos donde se busca establecer una relación entre dos variables.

La pendiente de la recta de regresión de Y sobre X: ¿Qué es y cómo se calcula?

Métodos para realizar el análisis de regresión

El análisis de regresión es una técnica estadística utilizada para evaluar la relación entre una variable dependiente y una o más variables independientes. Existen varios métodos para llevar a cabo el análisis de regresión. A continuación, se presentan algunos de ellos:

- Regresión lineal: Este es uno de los métodos más utilizados, donde se ajusta una línea recta a los datos para predecir la variable dependiente en función de una variable independiente.

- Regresión polinómica: En este método, se ajusta un polinomio a los datos en lugar de una línea recta. Es útil cuando la relación entre las variables no es lineal.

- Regresión logística: Se emplea cuando la variable dependiente es categórica en lugar de continua. Ayuda a predecir la probabilidad de que ocurra un evento en lugar de predecir un valor numérico.

Además, existen otros métodos más avanzados como la regresión no lineal, regresión de Ridge y regresión de Lasso, cada uno con sus propias peculiaridades y aplicaciones.

En cuanto a la implementación en Python, se pueden utilizar bibliotecas como scikit-learn para llevar a cabo el análisis de regresión. A continuación, un ejemplo simple de regresión lineal en Python:

from sklearn.linear_model import LinearRegression # Crear el modelo de regresión lineal modelo = LinearRegression() # Ajustar el modelo a los datos modelo.fit(X, y) # Realizar predicciones predicciones = modelo.

Esperamos que este análisis de regresión, ya sea de X sobre Y o Y sobre X, haya sido de utilidad para comprender la relación entre estas variables. Recordad que la estadística es una herramienta valiosa para la toma de decisiones informadas. ¡Hasta pronto!