Un Árbol de Decisión con índice Gini es una poderosa herramienta utilizada en el campo de la inteligencia artificial y el aprendizaje automatizado. Nos permite clasificar datos de forma eficiente, identificando patrones y tomando decisiones basadas en la pureza de los mismos. En este breve artículo exploraremos cómo funciona este algoritmo y por qué es fundamental en la toma de decisiones automatizadas. ¡Descubre cómo el índice Gini puede potenciar tus resultados!

Entendiendo el Gini en árboles de decisión

Donde **Pi** representa la proporción de cada clase en un nodo. Un valor de Gini cercano a 0 indica que el nodo es puro, es decir, contiene principalmente elementos de una sola clase. Por otro lado, un valor cercano a 0.5 o 1 implica una mayor impureza en el nodo.

Al dividir un nodo en un árbol de decisión, se busca minimizar el coeficiente de Gini. Se selecciona la división que resulta en la menor suma ponderada de Gini en los nodos hijos.

Cuando se interpreta un árbol de decisión, es importante entender cómo el coeficiente de Gini influye en la toma de decisiones. Las ramas con un Gini más bajo suelen ser consideradas como divisiones más efectivas, ya que separan mejor las clases de interés.

Tipos de árboles de decisión relevantes

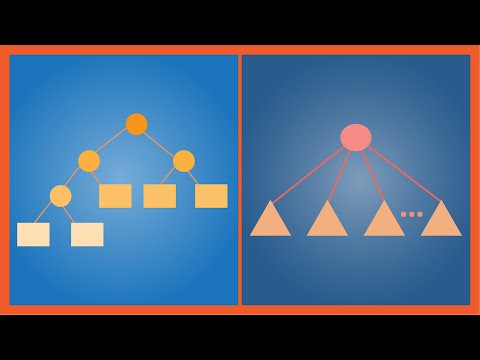

1. **Árboles de Decisión Clásicos (CART):**

– Son estructuras de árbol binario donde cada nodo representa una característica (o atributo) y cada rama representa un valor posible de esa característica.

– Ejemplo:

from sklearn.tree import DecisionTreeClassifier tree_model = DecisionTreeClassifier()

2. **Árboles de Decisión Aleatorios:**

– Introducen aleatoriedad en la construcción del árbol para mejorar la precisión y evitar sobreajustes.

– Ejemplo:

from sklearn.ensemble import RandomForestClassifier forest_model = RandomForestClassifier()

3. **Árboles de Decisión Extremadamente Aleatorios (Extra-Trees):**

– Similar a los árboles aleatorios, pero con nodos más aleatorios para reducir la varianza.

– Ejemplo:

from sklearn.ensemble import ExtraTreesClassifier extra_trees_model = ExtraTreesClassifier()

4. **Árboles de Decisión Gradiente Mejorado (Gradient Boosting Trees):**

– Método que construye árboles de manera secuencial para corregir los errores de predicción de los árboles anteriores.

– Ejemplo:

from sklearn.

🌳 Creación de un árbol de decisiones: guía paso a paso

La creación de un árbol de decisiones es una técnica utilizada en machine learning y data mining para la toma de decisiones predictivas. A continuación se presenta una guía paso a paso para crear un árbol de decisiones:

- Recopilación de datos: El primer paso es recopilar todos los datos relevantes para el análisis de decisiones.

- Selección de atributos: Seleccionar los atributos (características) más relevantes para el análisis de los datos.

- División del conjunto de datos: Dividir el conjunto de datos en conjuntos de entrenamiento y prueba.

- Creación del árbol: Utilizar algoritmos como ID3, C4.5 o CART para crear el árbol de decisiones.

- Podado del árbol: Realizar el proceso de poda para evitar el sobreajuste del modelo.

- Validación del modelo: Validar el rendimiento del árbol utilizando datos de prueba.

Además, es importante destacar que un árbol de decisiones se compone de nodos, ramas y hojas, donde cada nodo representa una característica, cada rama una decisión y cada hoja un resultado.

Para implementar un árbol de decisiones en Python, se pueden utilizar bibliotecas como scikit-learn. A continuación se muestra un ejemplo básico de código para crear un árbol de decisión:

from sklearn import tree # Crear un clasificador de árbol de decisiones clf = tree.DecisionTreeClassifier() # Entrenar el clasificador con datos de entrenamiento clf = clf.fit(X_train, y_train) # Realizar predicciones predictions = clf.

El Árbol de Decisión con Índice Gini es una poderosa herramienta de clasificación en machine learning que se basa en la pureza de los nodos. Con él, podemos tomar decisiones informadas y precisas en el análisis de datos. ¡Hasta pronto!